L’essor des intelligences artificielles spécialisées a transformé les industries, mais derrière chaque modèle performant se cachent des défis techniques complexes. Entre l’optimisation de l’entraînement, la gestion des biais, la qualité et la provenance des données, ainsi que la nécessité d’infrastructures massives et adaptées, les entreprises se retrouvent confrontées à des questions techniques cruciales. Cet article décortique ces enjeux, propose des solutions concrètes et met en lumière les bonnes pratiques qui permettent d’atteindre un équilibre entre performance et responsabilité.

Entraînement des IA spécialisées : enjeux et solutions

1. Le coût du calcul massif et la nécessité du fine‑tuning

Former un modèle de langage de base, comme GPT‑4, nécessite des ressources de calcul astronomiques (pensez aux milliers de GPU sur plusieurs semaines). Pour un cas d’usage spécialisé – par exemple un diagnostic médical ou une analyse financière – il n’est plus rentable de repartir de zéro. Le fine‑tuning permet de prendre un modèle pré‑entraîné et de l’adapter à un domaine spécifique en utilisant un jeu de données ciblé, réduisant ainsi le coût et le temps d’entraînement tout en conservant la capacité de généralisation du modèle de base. Des entreprises comme DeepMind et Anthropic utilisent cette approche pour créer AlphaFold ou Claude 2, respectivement.

2. Gestion de la qualité et de la diversité des données

L’efficacité d’un modèle spécialisé dépend en grande partie de la qualité des données d’entraînement. Un corpus trop homogène ou biaisé entraîne un modèle qui reproduit ces biais. Les équipes d’ingénieurs ML doivent donc mettre en place des pipelines de collecte, de nettoyage et d’enrichissement des données. Par exemple, la version médicale de BERT, BioBERT, a été entraînée sur des corpus de PubMed et de Europe PMC pour garantir une représentation fidèle du vocabulaire scientifique. Les pratiques de data‑augmentation, telles que le paraphrasing ou la traduction inversée, permettent également d’augmenter la diversité sans accroître les coûts de collecte.

3. Optimisation algorithmique et réduction de l’empreinte carbone

Les modèles spécialisés peuvent être optimisés à travers diverses techniques : quantification, distillation et pruning. La distillation consiste à transférer la connaissance d’un grand modèle (l’« enseignant ») vers un modèle plus compact (l’« élève »), conservant les performances tout en réduisant l’empreinte GPU. Quantifier les poids à 4 bits, par exemple, a permis à des entreprises comme NVIDIA de réduire la consommation d’énergie de plus de 70 % pour certaines tâches. En parallèle, les chercheurs explorent des architectures plus efficaces, comme les transformers « sparse » (Sparse Transformers) ou l’architecture Performer, qui réduisent la complexité quadratique du self‑attention.

Biais, données et infrastructure : comment les maîtriser?

1. Identification et atténuation des biais

Les biais se manifestent souvent sous forme de résultats discriminatoires ou de fausses prédictions, surtout lorsqu’un modèle est appliqué à des populations variées. Les outils de l’IA responsable – par exemple les bibliothèques Fairlearn ou AI Fairness 360 – permettent de mesurer le biais sur des métriques spécifiques (écart de précision entre groupes). Les techniques d’« debiasing » incluent la rééchantillonnation, l’ajustement des poids de perte ou l’utilisation de modèles de mélange apprenant explicitement à ignorer les attributs sensibles. De plus, la mise en place de « audit trails » (traçabilité des données et des décisions) aide les régulateurs et les entreprises à valider la conformité aux normes comme le RGPD.

2. Sécurisation et gouvernance des données

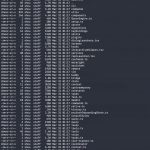

Les données médicales, financières ou juridiques sont souvent sensibles et soumis à des régulations strictes. Les entreprises doivent donc adopter un cadre de gouvernance des données robuste : chiffrement au repos et en transit, gestion fine des accès, et protocole de consentement éclairé. L’usage de registres de données fédérés (federated learning) permet de former des modèles sans centraliser les données, préservant la confidentialité tout en bénéficiant d’un large pool d’informations. Des plateformes d’orchestration comme Kubeflow ou MLflow facilitent le suivi de ces pipelines, garantissant la reproductibilité et la traçabilité.

3. Infrastructure adaptée et scalabilité

Les IA spécialisées requièrent des infrastructures capables de gérer des volumes massifs de calcul et de stockage tout en maintenant des temps de latence faibles. Les clusters GPU dédiés (NVIDIA A100, H100) ou les accélérateurs TPU de Google sont de base pour l’entraînement. Cependant, pour le déploiement, les entreprises tournent souvent vers des solutions edge ou hybride afin de réduire la latence et de garantir la souveraineté des données. Des services comme AWS SageMaker, Azure Machine Learning et Google Vertex AI offrent des environnements orchestrés, intégrant automatiquement la montée en charge, la gestion de versions et la sécurité. En adoptant une approche modulaire et basée sur le cloud, les organisations peuvent rapidement adapter leur infrastructure aux besoins évolutifs de leurs modèles spécialisés.

Les défis techniques des IA spécialisées sont nombreux, mais ils ne sont pas insurmontables. Grâce à des stratégies éprouvées d’entraînement ciblé, à une gouvernance rigoureuse des données et à des infrastructures optimisées, les entreprises peuvent déployer des modèles puissants tout en respectant les principes d’équité et de conformité. Chez Mak3it, nous accompagnons les organisations à travers ces étapes, en combinant expertise technique et vision éthique pour transformer la donnée en valeur durable.

Vous êtes entrepreneur, dirigeant ou simplement curieux d’IA ? Partagez vos questions ou expériences dans les commentaires ci‑dessus – nous serons ravis d’échanger avec vous.