Vous avez déjà essayé de faire tourner un modèle d’intelligence artificielle (LLM) en local sur votre ordinateur, pour vous rendre compte après 10 minutes de téléchargement qu’il est beaucoup trop lourd pour votre RAM ? C’est une frustration courante dans le monde de l’IA locale. Mais tout cela change aujourd’hui avec LLMFit.

Qu’est-ce que LLMFit ?

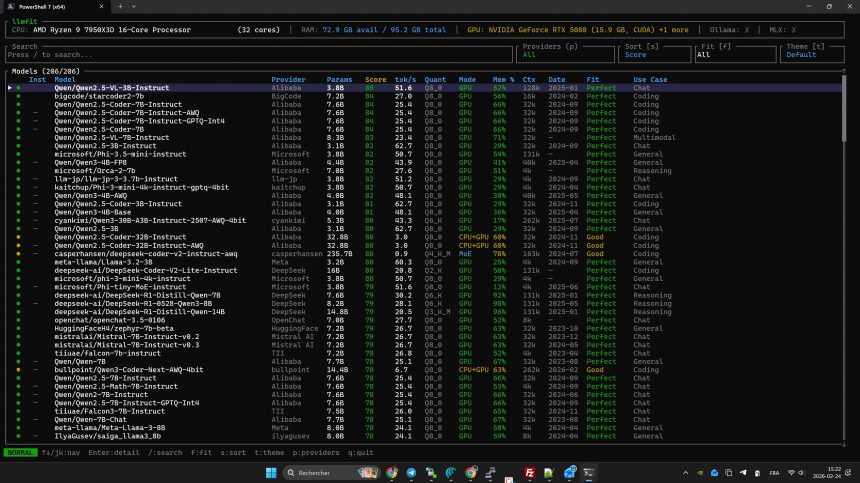

Développé par AlexsJones, LLMFit est un outil en ligne de commande (CLI) et une interface terminal (TUI) écrit en Rust. Sa mission est simple : analyser votre matériel (CPU, RAM, GPU, VRAM) et vous dire exactement quels modèles IA fonctionneront parfaitement sur votre machine.

Avec plus de 200 modèles répertoriés et le support de 57 fournisseurs (Meta Llama, Mistral, Qwen, Gemma, etc.), c’est l’outil indispensable pour quiconque souhaite optimiser son infrastructure d’IA locale.

Les avantages de l’IA locale avec LLMFit

Utiliser l’IA en local présente des avantages majeurs, et LLMFit les rend enfin accessibles sans devinettes :

- Confidentialité totale : Vos données ne quittent jamais votre machine.

- Zéro coût d’abonnement : Pas besoin de payer pour ChatGPT ou Claude si votre matériel peut faire tourner un modèle équivalent.

- Indépendance : Travaillez sans connexion internet.

- Optimisation précise : LLMFit sélectionne la meilleure quantization (compression) pour garder un équilibre entre vitesse et intelligence.

Comment ça marche ?

LLMFit ne se contente pas de lire votre fiche technique. Il utilise un système de score multidimensionnel :

- Qualité : Évalue la réputation et l’intelligence du modèle.

- Vitesse : Estime le nombre de tokens par seconde selon votre matériel (CUDA, Metal, ROCm, etc.).

- Ajustement (Fit) : Analyse l’utilisation de la mémoire pour éviter les crashs.

- Contexte : Vérifie si la fenêtre de contexte répond à vos besoins.

Installation et utilisation rapide

Pour les utilisateurs de macOS et Linux, l’installation est instantanée :

curl -fsSL https://llmfit.axjns.dev/install.sh | shUne fois installé, lancez simplement la commande llmfit. Vous verrez alors une liste interactive de tous les modèles classés par score de compatibilité avec votre matériel.

Intégration avec Ollama

Si vous utilisez déjà Ollama, LLMFit détecte automatiquement vos modèles installés et vous permet d’en télécharger de nouveaux directement depuis son interface.

Conclusion

LLMFit est le chaînon manquant pour démocratiser l’IA locale. Au lieu de tester au hasard, vous disposez désormais d’un conseiller technique qui connaît votre matériel sur le bout des doigts. Que vous soyez sur un MacBook Air ou un serveur avec 4 GPUs NVIDIA, LLMFit vous aidera à tirer le maximum de votre investissement matériel.

Prêt à passer à l’IA locale souveraine ? Installez LLMFit et découvrez la puissance cachée de votre ordinateur.